使用Kimi的免费API接口 - kimi-free-api在腾讯云开发者社区体验真香 --知识铺

今年,随着各大GLM模型的开源和算力的提升,尤其是最近比较火热的月之暗面的Kimi 模型,AI应用场景中的各种智能体如雨后春笋般涌现。许多同学们纷纷表达了加入AI应用的学习和测试的愿望,然而各大模型提供商所提供的API的免费tokens在数量和其他方面都存在着不同的限制,这给我们这些白嫖党带来了一定的不便。今天,在GitHub上,我发现了这个名为kimi-free-api的项目,它为我们学习和测试使用GLM模型提供了极大的便利。

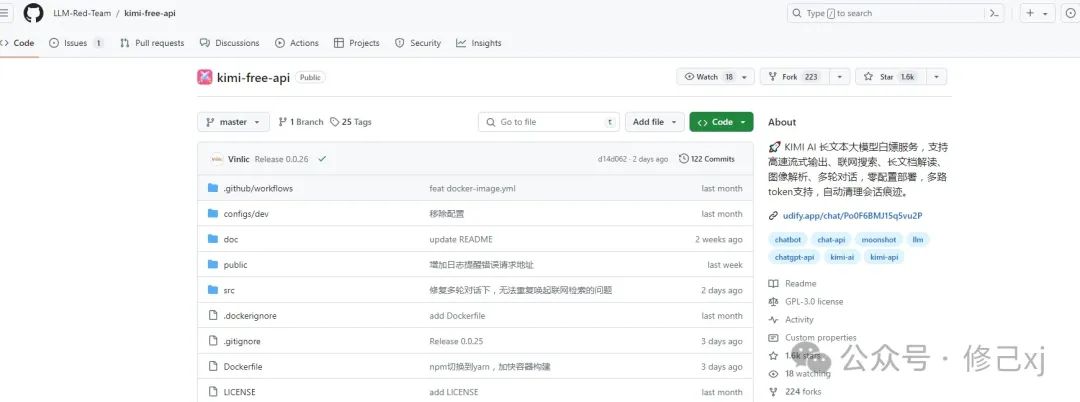

项目介绍

支持高速流式输出、支持多轮对话、支持联网搜索、支持长文档解读、支持图像解析,零配置部署,多路token支持,自动清理会话痕迹。

与ChatGPT接口完全兼容。

github地址: https://github.com/LLM-Red-Team/kimi-free-api

虽然Kimi新用户注册后会免费赠送 15 元额度。如果赠送额度用完了,你还想继续免费体验,那么,这个开源项目一定要试试。以下几个大模型也是一样。

阶跃星辰 (跃问StepChat) 接口转API step-free-api:https://github.com/LLM-Red-Team/step-free-api

阿里通义 (Qwen) 接口转API qwen-free-api:https://github.com/LLM-Red-Team/qwen-free-api

ZhipuAI (智谱清言) 接口转API glm-free-api:https://github.com/LLM-Red-Team/glm-free-api

秘塔AI (metaso) 接口转API metaso-free-api:https://github.com/LLM-Red-Team/metaso-free-api

聆心智能 (Emohaa) 接口转API emohaa-free-api:https://github.com/LLM-Red-Team/emohaa-free-api

接入准备

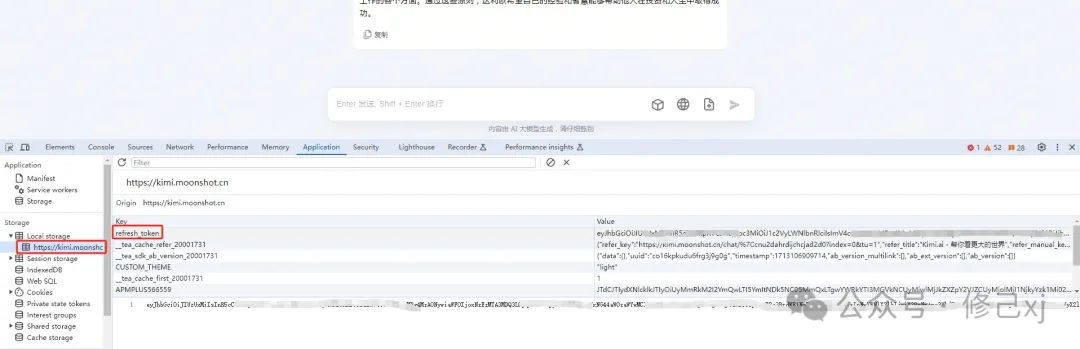

- 从 https://kimi.moonshot.cn 获取refresh_token

进入kimi随便发起一个对话,然后F12打开开发者工具,从Application > Local Storage中找到refresh_token的值,这将作为Authorization的Bearer Token值:Authorization: Bearer TOKEN

- 多账号接入

目前kimi限制普通账号每3小时内只能进行30轮长文本的问答(短文本不限),你可以通过提供多个账号的refresh_token并使用,拼接提供:

Authorization: Bearer TOKEN1,TOKEN2,TOKEN3

每次请求服务会从中挑选一个。

Docker-compose部署服务

- 创建docker-compose.yml文件

在部署目录下创建docker-compose.yml文件,写入以下内容:

|

|

- 启动服务

在docker-compose.yml文件的同级目录下使用以下命令启动服务

使用接口

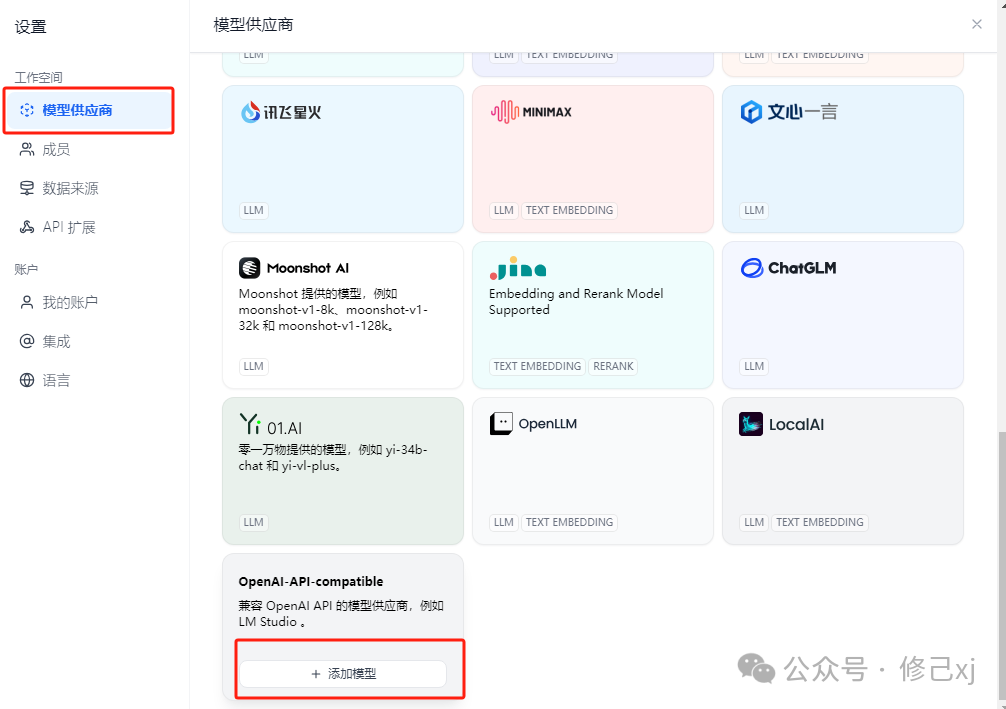

- 配置模型

我们此处是以dify为例使用的,使用其它开源服务也是可以的,比如chatgpt-next-web-proxy,lobe-chat等。

在dify的设置–>模型供应商->模型列表中选择OpenAI-API-compatible->添加模型

添加如下内容:

内容填写完毕后点击保存,这样我们模型就配置完毕了

- 测试api

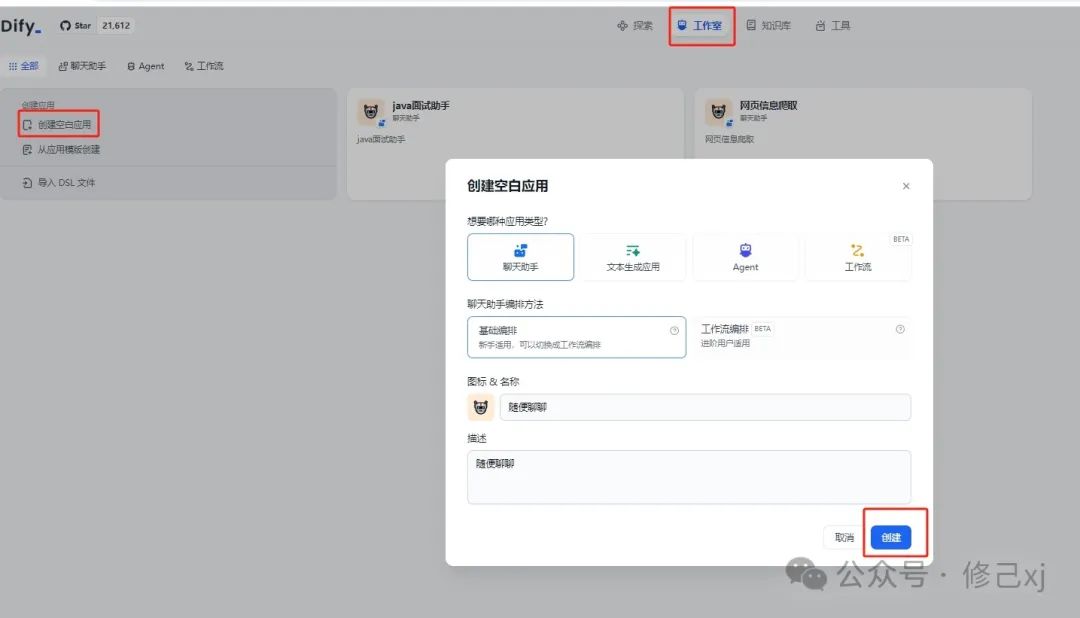

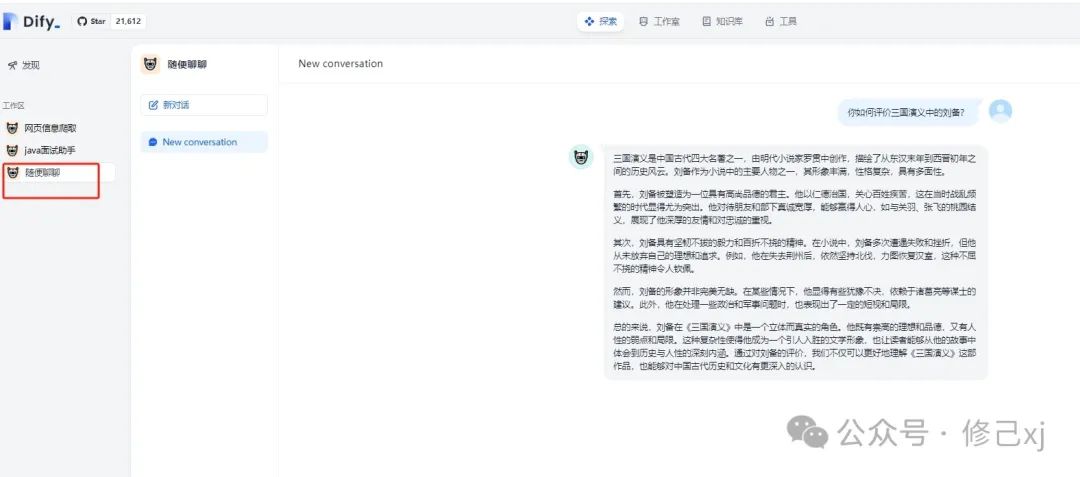

模型配置完毕后我们在dify的工作室中创建一个简单的聊天应用

创建完成后发布,我们在探索中使用这个应用

可以看到,我们已经可以使用这个api接口了。

总结

Kimi-free-api项目的出现,不仅为AI爱好者和开发者提供了便利,也推动了开源社区的发展。通过这些工具,我们可以更加便捷地探索AI的无限可能,共同期待未来AI技术带来的更多惊喜。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2024-04-14,如有侵权请联系 cloudcommunity@tencent.com 删除

- 原文作者:知识铺

- 原文链接:https://index.zshipu.com/geek001/post/20240710/%E4%BD%BF%E7%94%A8Kimi%E7%9A%84%E5%85%8D%E8%B4%B9API%E6%8E%A5%E5%8F%A3-kimi-free-api%E5%9C%A8%E8%85%BE%E8%AE%AF%E4%BA%91%E5%BC%80%E5%8F%91%E8%80%85%E7%A4%BE%E5%8C%BA%E4%BD%93%E9%AA%8C%E7%9C%9F%E9%A6%99--%E7%9F%A5%E8%AF%86%E9%93%BA/

- 版权声明:本作品采用知识共享署名-非商业性使用-禁止演绎 4.0 国际许可协议进行许可,非商业转载请注明出处(作者,原文链接),商业转载请联系作者获得授权。

- 免责声明:本页面内容均来源于站内编辑发布,部分信息来源互联网,并不意味着本站赞同其观点或者证实其内容的真实性,如涉及版权等问题,请立即联系客服进行更改或删除,保证您的合法权益。转载请注明来源,欢迎对文章中的引用来源进行考证,欢迎指出任何有错误或不够清晰的表达。也可以邮件至 sblig@126.com