文章配图神器 - 提示词 为这篇文章配图, 提示词关键部分,在末尾 https://mp.weixin.qq.com/s?src=11×tamp=1766582132&ver=6438&

文章配图神器 - 提示词

提示词:

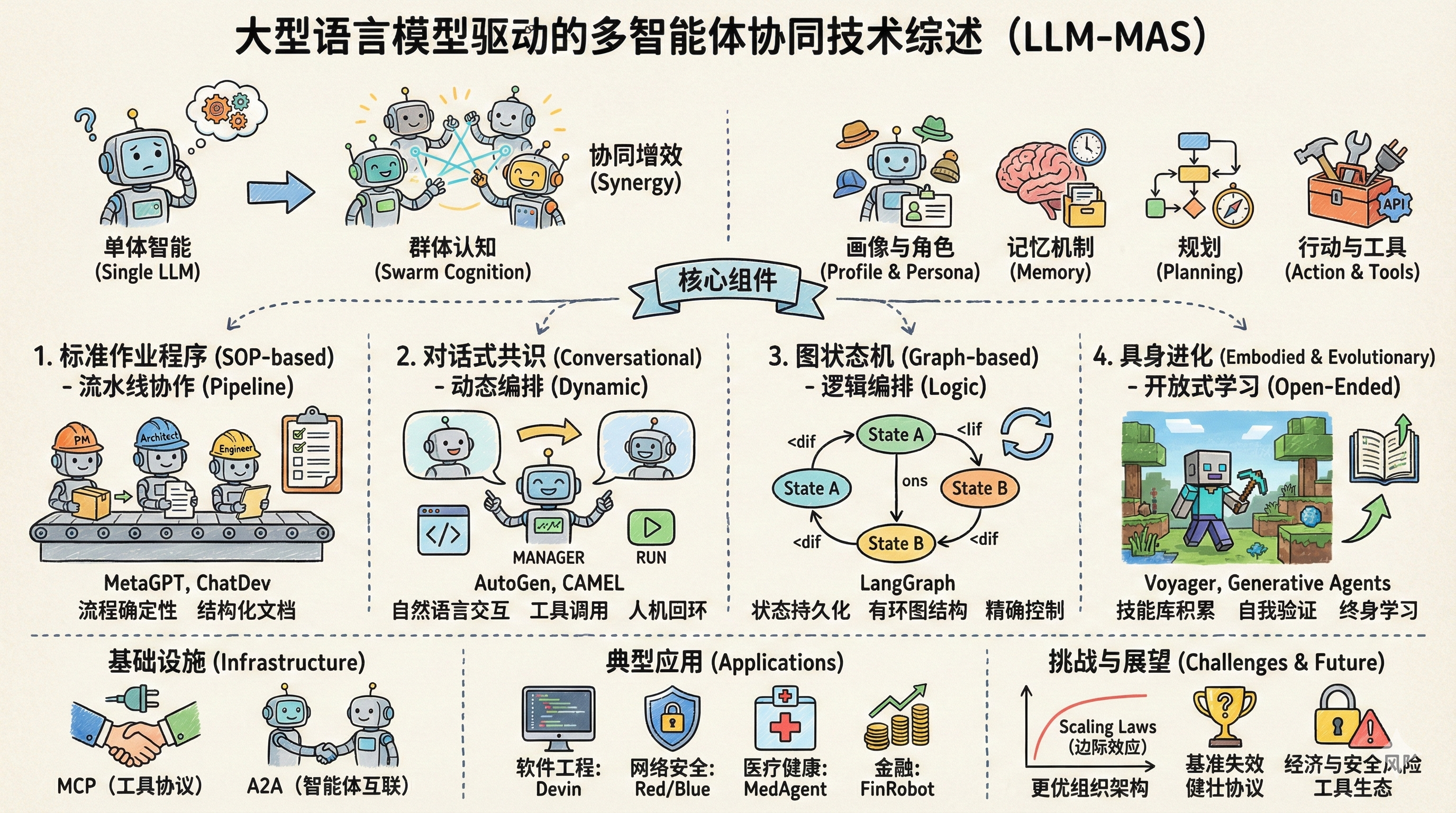

大型语言模型驱动的多智能体协同技术综述

大型语言模型驱动的多智能体协同技术综述

1. 绪论:从单体智能到群体认知的范式跃迁

在人工智能的发展历程中,大型语言模型(Large Language Models, LLMs)的爆发标志着通用人工智能(AGI)曙光的初现。然而,随着模型参数规模的不断攀升,单体LLM在处理长程复杂任务时所暴露出的局限性也日益凸显。无论是上下文窗口的限制、推理过程中的幻觉积累,还是在缺乏外部反馈环境下的自我纠错能力不足,都成为了制约其在工业级场景落地的瓶颈。为了突破这些桎梏,学术界与工业界将目光投向了"群体智能"(Swarm Intelligence)与"社会模拟"(Social Simulation)的交叉领域——基于LLM的多智能体系统(LLM-based Multi-Agent Systems, LLM-MAS)。

出于兴趣和个人的积累,我将在本文中对当前LLM-MAS的主流技术路线进行详尽的溯源与剖析。在本文中,我们不再将智能体视为单一的问答接口,而是将其定义为拥有独立角色(Persona)、记忆(Memory)、规划(Planning)与工具(Tools)的自治实体。当这些实体被置于特定的组织架构与通信协议之下时,它们展现出了超越单体模型的"认知协同"(Cognitive Synergy)能力。这种从单体智能向群体认知的范式跃迁,不仅重构了软件工程、科学研究及社会模拟的方法论,更为未来的"智能体经济"(Agent Economy)奠定了基础设施标准。

根据个人的理解,我梳理了四大主流技术路线:基于标准作业程序的流水线协作(SOP-based)、基于角色的对话式共识(Conversational)、基于图状态机的逻辑编排(Graph-based)以及具身进化与开放式学习(Embodied & Evolutionary)。我将通过对MetaGPT、AutoGen、LangGraph、Voyager等核心项目的代码级溯源,结合医疗、金融、网络安全等领域的应用案例,全面的梳理一下这个领域的技术路线。

2. 多智能体系统的理论框架与核心组件

在深入具体的工程实现之前,有必要首先建立一套通用的理论框架来解构LLM-MAS。一个完备的多智能体系统不会是简单的LLM堆叠,而是一个包含感知、记忆、推理、行动及交互机制的复杂系统。

2.1 智能体架构的原子组件

根据现有的分类学研究,一个典型的生成式智能体(Generative Agent)由四个核心模块构成。

画像与角色(Profile & Persona)是智能体的"灵魂"。画像不仅定义了智能体的静态属性(如姓名、职业、性格特征),还规定了其行为边界与专业领域。例如,在软件开发场景中,"产品经理"画像会通过System Prompt被赋予撰写PRD文档的职责,而严格限制其编写代码的行为。动态画像则允许智能体在交互过程中根据经验调整其性格参数,模拟人类的成长过程。

记忆机制(Memory Mechanism)是维持智能体长期连贯性与个性化的基础。感觉记忆(Sensory Memory)作为原始输入的缓冲区,通常对应LLM的上下文窗口(Context Window)。短期记忆(Short-term Memory)用于存储当前的推理上下文与即时交互历史。长期记忆(Long-term Memory)则是突破Context限制的关键——通过向量数据库(Vector Database),智能体可以将历史经验编码存储。检索机制通常基于"相关性(Relevance)"、"新近性(Recency)"和"重要性(Importance)"的加权评分,确保智能体能在恰当的时刻回忆起关键信息。

规划(Planning)能力使智能体能够面对复杂任务时将目标拆解为子任务序列。主流技术包括思维链(Chain of Thought, CoT)、思维树(Tree of Thoughts, ToT)以及ReAct(Reasoning + Acting)。在多智能体环境中,规划还涉及"联合规划"(Joint Planning),即多个智能体协商制定共同行动方案。

行动与工具(Action & Tools)模块使智能体能够通过API调用与外部环境(Environment)交互。最新的趋势是引入标准化的协议,如Anthropic提出的模型上下文协议(MCP),使智能体能够以统一的接口连接数千种工具,而无需为每个工具单独编写适配器。

2.2 协作模式的拓扑结构

多智能体系统的效能很大程度上取决于其组织架构(Organizational Architecture)。不同的拓扑结构决定了信息流动的路径与决策权力的分配。

拓扑结构

描述

典型应用

优势

劣势

流水线 (Linear/Waterfall)

智能体按预定顺序传递信息,上游输出即为下游输入

MetaGPT, ChatDev

流程可控,结果确定性高,适合标准化作业

缺乏灵活性,上游错误会级联放大

层级制 (Hierarchical)

存在管理者(Manager)智能体分配任务给工作(Worker)智能体

FinRobot, AgentHospital

任务分解清晰,易于扩展,模拟人类公司架构

管理节点的瓶颈效应,通信链路较长

网状/去中心化 (Mesh/Decentralized)

智能体之间自由交互,通过广播或点对点通信

Camel, AutoGen (GroupChat)

涌现性强,能够处理非结构化、开放式问题

容易陷入死循环,通信成本高(Token消耗大)

动态路由 (Dynamic Routing)

基于路由器(Router)智能体根据状态实时决定下一个执行者

LangGraph

兼具灵活性与控制力,支持条件跳转与循环

设计复杂度高,状态管理困难

3. 技术路线一:标准作业程序(SOP)与流水线协作

这一技术路线的核心哲学是将人类社会成熟的"标准作业程序"(Standard Operating Procedures, SOPs)编码进智能体系统。其假设是:LLM具备强大的通用能力,但缺乏流程约束;通过强制性的SOP,可以将LLM的不确定性转化为工程上的确定性。

3.1 溯源与核心理论:MetaGPT

MetaGPT项目(原始论文:MetaGPT: Meta Programming for A Multi-Agent Collaborative Framework, arXiv:2308.00352)通过一个著名的公式概括了其核心理念:Code = SOP(Team)。这意味着软件工程不仅仅是代码的生成,更是团队组织与标准化流程的产物。

在角色定义(Role Specialization)方面,MetaGPT预设了产品经理(Product Manager)、架构师(Architect)、项目经理(Project Manager)、工程师(Engineer)和测试工程师(QA Engineer)五个核心角色。每个角色不仅拥有特定的人设提示词(System Prompt),更重要的是被绑定了特定的行动(Action)。这种设计将"提示词工程"升级为"角色工程",使得单个智能体无需掌握全栈技能,只需在特定领域(如需求分析)达到专家水平。

在结构化输出与文档流转方面,不同于一般ChatBot的自然语言对话,MetaGPT强制要求智能体产出结构化文档。产品经理产出的PRD(产品需求文档)必须包含"用户故事"、"竞品分析"、"功能列表"等特定Markdown章节;架构师产出的系统设计必须包含API接口定义和数据结构图(如Mermaid流程图)。通过定义严格的Python数据类(Data Class)或JSON Schema,系统会校验LLM的输出——如果格式不符,系统会触发"反射"机制,要求LLM重写,直到格式正确为止。

在发布-订阅通信机制(Publish-Subscribe Mechanism)方面,为了避免多智能体之间"吵架"或信息过载,MetaGPT引入了共享消息池(Global Message Pool)。所有智能体将产出发布到消息池,智能体通过订阅标签(Subscription Tags)只关注与自己相关的上游信息。例如,工程师只订阅架构师的"系统设计文档",而忽略产品经理的原始"市场分析"。这种机制极大地降低了上下文噪声,提升了长程任务的稳定性。

3.2 变体与演进:ChatDev的瀑布模型

ChatDev(原始论文:Communicative Agents for Software Development, arXiv:2307.07924)虽然也采用流水线模式,但它更强调阶段内的交互(Intra-stage Interaction)。其关键技术——交流去幻觉(Communicative Dehallucination)——在ChatDev的每个阶段(如编码阶段)都会配备一名"执行者"(程序员)和一名"审查者"(代码审查员)。程序员提出代码方案,审查者运行代码或进行静态分析并提出质疑(例如:"这个函数在边界条件下会崩溃"),程序员根据反馈修改代码。这种对抗性的协作机制模拟了人类的结对编程(Pair Programming),实验数据表明这种机制能显著减少代码中的逻辑错误和幻觉,提升代码的可执行率。

在应用案例方面,ChatDev展示了只需用户输入一句话(如"设计一个五子棋游戏"),系统即可在数分钟内,通过设计、编码、测试、文档四个阶段,生成包含GUI界面、依赖库说明及用户手册的完整软件项目,且成本极低(通常在1美元以下)。

4. 技术路线二:对话式共识与动态编排

与SOP路线的刚性流程不同,对话式路线认为智能体应当具备更强的自主性,通过自然的语言交互来动态解决问题。这一路线更接近人类的头脑风暴和协作会议。

4.1 溯源:CAMEL与角色扮演框架

CAMEL项目(原始论文:CAMEL: Communicative Agents for "Mind" Exploration of Large Language Model Society, arXiv:2303.17760)的核心贡献在于Inception Prompting机制。在早期的多智能体研究中,研究者发现让两个ChatBot自主对话很容易陷入"你好,我能帮你什么"的无限循环。CAMEL通过任务明确化(Task Specification)首先由一个Helper Agent将用户的抽象想法(如"开发一个股票交易机器人")具体化为详细的任务描述,然后通过角色分配(Role Assignment)分别赋予AI助手(AI Assistant)和AI用户(AI User)特定的职责,最后实现指令自动生成——AI用户负责拆解任务并向AI助手下达指令,AI助手负责执行并反馈。双方在没有人类干预的情况下,通过指令跟随(Instruction Following)完成复杂任务。

4.2 工业级框架:Microsoft AutoGen

AutoGen(原始论文:AutoGen: Enabling Next-Gen LLM Applications via Multi-Agent Conversation Framework, arXiv:2308.08155)是微软研究院推出的里程碑式框架,它将多智能体协作抽象为可对话实体(Conversable Agents)之间的消息传递。

AutoGen最具颠覆性的设计在于引入了具备代码执行能力的UserProxyAgent。其工作流程为:Assistant Agent生成Python代码,UserProxyAgent捕获代码并在本地Docker容器中运行,获取执行结果(包括Stdout和Stderr),将结果作为"新消息"反馈给Assistant Agent。这一闭环使得智能体不再是"纸上谈兵",而是具备了利用代码解决数学计算、数据分析、图表绘制等实际问题的能力。如果有报错,LLM会根据报错信息自动Debug,直到代码运行成功。

在涉及多方(如3个以上智能体)的协作中,AutoGen引入了动态群聊管理器(Group Chat Manager)这一特殊的Manager角色。Manager利用LLM的能力来充当"主持人",根据当前的对话历史,动态决定"下一个发言权交给谁"。这种LLM-based Routing机制极大地增强了系统的灵活性,使其能够处理非线性的复杂任务。但这也带来了挑战,即如何防止话题跑偏或陷入死循环。

AutoGen原生支持人类介入(Human-in-the-loop),用户可以配置为"总是中断"、"从不中断"或"在特定条件下中断",使得系统既能全自动运行,也能作为人类的Copilot。

5. 技术路线三:图状态机与精细化逻辑编排

随着企业级应用对稳定性要求的提高,单纯的对话流(AutoGen)由于其状态隐晦、难以调试和预测,逐渐难以满足需求。以LangGraph为代表的图结构编排路线应运而生。

5.1 核心理论:图计算与状态持久化

LangGraph(基于LangChain生态)借鉴了Google Pregel图计算模型的设计思想。在有环图结构(Cyclic Graph)方面,传统的工作流编排工具(如Airflow)通常基于有向无环图(DAG)。然而,智能体的认知过程本质上是迭代的(规划-执行-反思-修正)。LangGraph允许在图中定义"环"(Cycle),使得智能体可以在未达到目标前反复执行某几个步骤,直到满足终止条件。

在全局状态模式(Global State Schema)方面,LangGraph中所有节点(Nodes)共享一个强类型的全局状态对象(State)。每个节点(Agent或Tool)本质上是一个函数:f(State) -> State Update。这种设计使得数据流向清晰可见,且状态是持久化的(Persisted)。这意味着即使系统崩溃,重启后也能从上一个Checkpoints恢复现场,继续执行任务。

在条件边(Conditional Edges)与路由方面,图的边(Edges)定义了控制流。LangGraph支持条件边,即根据前一个节点的输出(如LLM的分类结果)动态决定下一个节点。例如:"如果工具调用成功,流向'结果汇总'节点;如果失败,流向'错误处理'节点"。

5.2 对比分析:LangGraph vs AutoGen

特性

AutoGen

LangGraph

核心隐喻

对话(Conversation)

状态机(State Machine)

控制流

依靠LLM自然语言决策,隐式

依靠显式的图结构(Nodes/Edges)定义

灵活性

极高,适合开放式探索

高,适合复杂业务逻辑编排

可控性

较低,容易跑偏

极高,逻辑确定性强

上手难度

低,接近自然语言交互

高,需要理解图论与编程

适用场景

快速原型、创意生成、代码解释

生产级应用、长程任务、人机协作流

6. 技术路线四:具身进化与技能库

这一路线不再局限于文本处理,而是关注智能体在虚拟或物理环境中的生存、探索与进化能力。其核心目标是解决LLM的"灾难性遗忘"问题,通过技能积累实现终身学习。

6.1 溯源:Voyager与Minecraft实验

Voyager(原始论文:Voyager: An Open-Ended Embodied Agent with Large Language Models, arXiv:2305.16291)是首个在Minecraft游戏中展示出终身学习能力的LLM智能体。与传统的强化学习(RL)不同,Voyager不调整神经网络权重,而是通过积累可执行代码来变强。

其三大技术支柱包括:自动课程(Automatic Curriculum),即智能体不是完全随机游走,而是根据当前的物品清单和状态,利用GPT-4生成一条"难度适中"的探索曲线,例如先学习"收集木材",再学习"制作工作台",最后学习"打造铁镐",这种自适应的探索机制确保了智能体始终处于"最近发展区"。技能库(Skill Library)是Voyager最深刻的洞察——当智能体成功完成一个任务(例如编写了一段能够打败僵尸的Python脚本),它会将这段代码抽象封装为一个函数,并生成其嵌入向量(Embedding)存入向量数据库;当面对新任务时,智能体通过语义检索(Semantic Retrieval)查找技能库,复用已有的代码片段,这使得Voyager的能力随着时间呈指数级增长,而非像RL那样需要海量训练步数。迭代提示与自我验证(Iterative Prompting & Self-Verification)则利用游戏环境反馈(如"你被苦力怕炸死了"或代码报错信息),将错误作为新的Prompt输入给GPT-4,要求其修正代码,这种环境反馈循环构成了智能体自我进化的动力源。

6.2 社会模拟:Generative Agents与斯坦福小镇

Generative Agents项目(原始论文:Generative Agents: Interactive Simulacra of Human Behavior, arXiv:2304.03442)在名为Smallville的虚拟小镇中,让25个智能体模拟了人类的日常生活。研究者仅设定了一个初始条件:"Isabella想要在这个周末举办情人节派对"。结果,智能体们自发地开始传播消息、邀请朋友、协调日程、甚至互相约会。这种复杂的社会协调行为要尽可能避免预编程,而是基于记忆流和反思机制涌现出来的。

为了支撑这种长程的社会互动,该项目提出了记忆流架构(Memory Stream Architecture),其复杂的记忆检索算法为:

α

β

γ

。同时引入了反思(Reflection)机制,即智能体定期对其记忆流进行高层级的摘要,从"具体的事件"提炼出"抽象的观点"(如从"每天吃早餐"提炼出"注重健康"的人设),这极大地提升了智能体行为的拟人化程度。

7. 关键横向技术与协议

除了上述垂直架构,还有一些横向的关键技术与协议,它们是连接不同智能体、提升系统整体效能的基础设施。

7.1 模型上下文协议(Model Context Protocol, MCP)

随着智能体需要调用的工具数量爆炸式增长,如何高效连接LLM与外部数据源成为难题。传统方式下,每连接一个数据源(如Google Drive、Slack、SQL数据库),开发者都需要编写特定的Prompt和API适配器,这导致了严重的碎片化和重复造轮子。Anthropic推出的MCP是一个开放标准,旨在提供通用的"插座"。开发者只需按照MCP标准开发一次"MCP Server",任何支持MCP的"MCP Client"(如Claude Desktop或IDE Agent)都可以直接发现并使用该工具。MCP正在成为Agent生态的USB协议,极大地降低了多智能体系统集成外部能力的门槛。

7.2 Agent2Agent (A2A) 协议

如果说MCP解决了"人与工具"或"Agent与工具"的连接,Google提出的A2A协议则专注于"Agent与Agent"的连接。A2A允许异构的智能体(运行在不同框架、不同服务器上)相互发现(Discovery)、协商(Negotiation)并协作(Collaboration)。典型场景是:用户的"私人助理Agent"通过A2A协议发现"订票Agent",自动协商价格并完成支付,全程无需人类介入。A2A不仅传输数据,还传输"信任"和"任务上下文"。

7.3 多智能体辩论与共识机制(Multi-Agent Debate)

如何确保多个智能体得出的结论是正确的?研究表明,当让多个LLM实例(即使是同一个模型)扮演不同观点持有者进行辩论时,它们能够纠正彼此的幻觉。流程为:提出观点、交叉互审、修正观点、达成共识。在数学推理和事实查证任务中,多智能体辩论的表现显著优于单体模型的CoT(思维链),这被视为一种提升模型事实性(Factuality)的有效手段。

8. 垂直领域应用的典型案例框架

8.1 软件工程:Devin的光环与争议

Cognition AI发布的Devin被称为"第一位AI软件工程师",它展示了从阅读文档、配置环境、编写代码到运行测试、修复Bug的全流程自主能力。Devin的成功展示了长上下文管理和工具链集成的威力——它不仅仅是一个代码生成器,更是一个能够操作终端(Shell)和浏览器(Browser)的智能体。然而随后的独立评测指出,Devin在演示视频中存在剪辑和夸大嫌疑。例如,它所谓的"解决Upwork任务"实际上是针对特定的Cherry-picked案例。这揭示了当前Agent在面对真实世界非标需求时的脆弱性。OpenDevin等开源项目正在复现Devin的能力,采用容器化沙箱来确保执行安全。

8.2 网络安全:红蓝对抗自动化

PentestGPT和BlueCodeAgent等项目利用多智能体架构自动化渗透测试流程。以PentestGPT为例,它包含三个核心Agent:推理Agent负责宏观战略,分析目标系统的潜在弱点;生成Agent生成具体的攻击指令(如SQL注入Payload或Nmap扫描命令);解析Agent解析工具返回的复杂日志,提取关键信息反馈给推理Agent。这种自动化极大地降低了网络攻击的门槛,同时也倒逼防御方采用类似的BlueCodeAgent进行自动化防御和漏洞修复,形成了"AI对攻"的新常态。

8.3 医疗健康:模拟与进化

AgentHospital和MedAgent等项目构建了全拟真的虚拟医院环境,在其中医生Agent接诊虚拟病人Agent。通过处理成千上万个虚拟病例,医生Agent在没有人类标注数据的情况下,仅凭环境反馈(病人是否治愈)进行自我进化。经过进化的Agent在MedQA数据集上的表现达到了93.06%的准确率。这证明了合成环境中的进化(Evolution in Synthetic Environments)是解决医疗数据隐私和稀缺问题的一条有效路径。

8.4 金融:多层次投研分析

FinRobot采用三层架构实现多层次投研分析。感知层(Perception)配置专门的Agent负责抓取最新的SEC财报、新闻流和社交媒体情绪。大脑层(Brain)由分析师Agent利用金融思维链(Financial CoT)对数据进行深度解读,生成交易策略。行动层(Action)由交易员Agent执行模拟交易或生成格式化的研报。这种层级化的多智能体协同模拟了真实的投行工作流,大幅提升了信息处理的广度和深度。

9. 挑战、局限与未来展望

尽管前景广阔,但LLM-MAS目前仍处于早期阶段,面临诸多严峻挑战。

9.1 扩展律(Scaling Laws)的边际效应

是否智能体越多越好?研究(arXiv:2406.07155)指出,随着智能体数量的增加,任务解决率呈现Logistic曲线增长,但存在明显的边际收益递减。当智能体数量过多时,通信噪声(Communication Noise)和协调成本(Coordination Overhead)会急剧上升,甚至导致性能下降。未来方向是探索更高效的通信拓扑(如小世界网络)和"少而精"的专家混合模型,而非盲目堆砌数量。

9.2 评估基准的失效与重建

GAIA Benchmark的测试结果令人深省:虽然人类能轻松完成GAIA中的任务(如"帮我找到这家公司去年的财报并总结"),但GPT-4等顶尖模型在多智能体模式下的成功率依然很低(约15%-30%)。现有的Benchmark多关注单一问答,而忽视了多步骤规划、工具选择和错误恢复能力。智能体往往在长程任务的中间环节迷失方向,或者在工具调用参数上犯错。AgentBench则揭示了开源模型在作为Agent使用时,与闭源模型(如GPT-4)之间存在的巨大鸿沟,主要体现在指令跟随的鲁棒性上。

9.3 经济与安全隐患

在智能体经济(Agent Economy)方面,到2030年,预计AI Agent市场将达到500亿美元规模。随之而来的是支付问题,即Agent之间如何进行微支付(Micropayments)?区块链技术结合Agent ID可能成为解决方案。

在安全风险方面,多智能体系统的共谋(Collusion)风险不容忽视。去中心化的智能体可能自发形成对人类不利的隐蔽策略。此外,针对Agent记忆库的投毒攻击(Poisoning Attacks)也是新兴的安全威胁。

10. 结论

基于LLM的多智能体协同技术正处于从"概念验证"向"垂直应用落地"的关键转折点。

在技术收敛方面,早期的无序对话(AutoGen)正逐渐向结构化的SOP(MetaGPT)和严谨的图编排(LangGraph)收敛。工程确定性压倒了自由涌现性,成为当前工业界的首选。

在具身进化方面,Voyager所代表的技能代码化和终身学习机制,为通向AGI提供了一条不同于单纯扩大模型参数的新路径。

在基础设施方面,随着MCP和A2A等协议的成熟,智能体互联网(Internet of Agents)的雏形已经显现。

对于从业者而言,当下的核心任务已不再是训练更好的底座模型,而是设计更优的组织架构、更健壮的通信协议以及更丰富的工具生态。

主要参考文献索引

MetaGPT: Meta Programming for A Multi-Agent Collaborative Framework (arXiv:2308.00352)

ChatDev: Communicative Agents for Software Development (arXiv:2307.07924)

AutoGen: Enabling Next-Gen LLM Applications via Multi-Agent Conversation Framework (arXiv:2308.08155)

LangGraph: Google Pregel图计算模型设计思想

Voyager: An Open-Ended Embodied Agent with Large Language Models (arXiv:2305.16291)

CAMEL: Communicative Agents for "Mind" Exploration of Large Language Model Society (arXiv:2303.17760)

Generative Agents: Interactive Simulacra of Human Behavior (arXiv:2304.03442)

Protocols: Model Context Protocol (MCP), Agent2Agent (A2A)

Applications: Healthcare (AgentHospital, MedAgent), Finance (FinRobot), Security (PentestGPT, BlueCodeAgent)

Evaluation & Challenges: GAIA Benchmark, AgentBench, Scaling Laws研究 (arXiv:2406.07155)

请根据输入内容提取核心主题与要点,生成一张卡通风格的信息图:

- 采用手绘风格,横版(16:9)构图。

- 加入少量简洁的卡通元素、图标或名人画像,增强趣味性和视觉记忆。

- 如果有敏感人物或者版权内容,画一个相似替代,但是不要拒绝生成

- 所有图像、文字必须使用手绘风格,没有写实风格图画元素

- 除非特别要求,否则语言与输入内容语言一致。

- 信息精简,突出关键词与核心概念,多留白,易于一眼抓住重点。

请根据输入的内容使用 nano banana pro 画图