chattts 生产环境部署 --知识铺

ChatTTS生产环境部署指南

本指南将详细介绍如何在生产环境中部署ChatTTS,包括必要的安装步骤和验证过程。

环境准备

安装WSL2

WSL2是Windows内置的Linux子系统,它允许在Windows上运行Linux环境。请按照官方文档进行安装。

安装CUDA和cuDNN

CUDA和cuDNN是NVIDIA提供的用于GPU加速的并行计算平台和深度学习库。请根据系统配置和需求安装相应版本。

安装Git

Git是一个分布式版本控制系统,用于代码的版本控制。请访问Git官网下载并安装。

使用PowerShell下载ChatTTS代码

PowerShell是一个跨平台的自动化和配置工具,用于命令行操作。使用PowerShell下载ChatTTS的代码和模型文件。

部署步骤

创建虚拟环境

在Python项目中,创建虚拟环境以隔离项目依赖。

安装依赖库

在虚拟环境中,使用pip install -r requirements.txt命令安装ChatTTS所需的Python库。

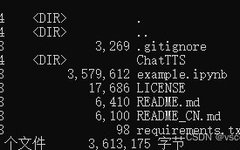

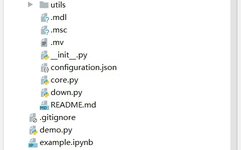

下载ChatTTS代码和模型

使用git clone命令从Git仓库下载ChatTTS的代码和模型文件。

运行和验证

激活虚拟环境

在运行ChatTTS之前,确保激活了创建的虚拟环境。

运行ChatTTS

运行ttsollama.py或其他相关脚本进行测试,确保ChatTTS能够生成自然流畅的语音输出。

验证部署结果

如果一切正常,ChatTTS将成功运行并输出语音。这标志着部署成功。

确保所有步骤都按照指南正确完成,ChatTTS将在生产环境中稳定运行,适用于需要高质量语音合成的应用场景。

本地化_ChatTTS_安装_部署_——搭建私有化应用 - 简书

2024年6月18日

(2)、通过git工具下载模型文件 指令:git clone https://www.modelscope.cn/pzc163/_chatTTS_.git ChatTTS-Model (3)、通过git工具下载ChatTTS源码文件 指令:git …

语音生成大模型_ChatTTS_本地_部署_和推理 - 知乎

[

aaaaaaa aaaaaaa aaaaaaa 2024年6月6日

使用第三方包 ChatTTS_colab 进行推理

3.1 安装

在开始之前,请确保您已经创建了与ChatTTS兼容的环境,并激活该环境。

|

|

接着,通过git克隆仓库来获取ChatTTS_colab的代码:

|

|

进入克隆下来的目录,并安装所需依赖包:

|

|

请按照上述步骤设置您的开发环境。如果有任何问题或需要进一步的帮助,请查阅官方文档或者联系维护者。

](http://www.baidu.com/link?url=PhBCF4lPWx2mfKcO8NF_57ygCvHckxUIsxQ9rqpBd7l5XvbfZCr-vPl9xwFoA2hv)

chat-tts V3本地_部署_教程 - 抖音

【ChatGML3】最强的离线开源版ChatGPT,一键_部署_,解压即用 #chatgpt #AI #人工智能 00:00 / 03:31 连播 清屏 智能 倍速 点赞399 AI垫脚石卒3月前_ChatTTS_使用教程及本地部署一…

ChatTTS本地部署教程

目录

- 本地部署准备 1.1 下载ChatTTS代码 1.2 通过modelscope下载ChatTTS模型

- 验证 2.1 使用Jupyter验证 2.2 编写ttsollama.py代码 2.3 运行ttsollama.py

1. 本地部署准备

1.1 下载ChatTTS代码

将代码库拷贝到本地英文目录下。可以使用以下命令:

|

|

1.2 通过modelscope下载ChatTTS模型

运行Python并输入以下代码,或创建download.py文件并运行python download.py进行下载:

|

|

如果遇到ModuleNotFoundError错误,说明未安装modelscope。可以通过以下命令创建ChatTTS环境并安装modelscope:

|

|

下载的模型数据默认位于C:\Users\Administrator.cache\modelscope\hub\pzc163\chatTTS目录。

2. 验证

2.1 使用Jupyter验证

打开VSCode(需安装Jupyter插件),在ChatTTS的conda环境下运行以下命令:

|

|

2.2 编写ttsollama.py代码

确保ollama已在本地运行,可以访问http://localhost:11434。编写ttsollama.py代码,使用qwen:7b模型。

2.3 运行ttsollama.py

运行ttsollama.py输出result.wav。如果物理机只有CPU,运行可能会较慢,但本地部署是免费的。

2024年5月31日 model_dir = snapshot_download(‘pzc163/chatTTS’) 不写绝对路径就会保存在这个位置 C:\Users\Administrator\.cache\modelscope\hub\pzc163 下载完之后移动到自己的工程下,目录如下…

当下最强AI语音神器,_ChatTTS_本地_部署_教程 - 知乎

[

FFmpeg 安装指南

FFmpeg 是一个开源的多媒体框架,广泛应用于音频和视频的处理。在 ChatTTS 项目中,FFmpeg 主要负责录制、转换和传输音频。若要部署 ChatTTS,必须先安装 FFmpeg,否则程序将无法运行。

安装步骤

- 下载最新的 FFmpeg 压缩包。

- 将压缩包解压到 C 盘的 Program Files 文件夹中。

注意事项

-

确保在安装前已经下载了正确的压缩包。

-

解压路径应选择系统盘(通常是 C 盘)下的 Program Files 文件夹,以避免权限问题。

- 原文作者:知识铺

- 原文链接:https://index.zshipu.com/geek002/post/202410/chattts-%E7%94%9F%E4%BA%A7%E7%8E%AF%E5%A2%83%E9%83%A8%E7%BD%B2--%E7%9F%A5%E8%AF%86%E9%93%BA/

- 版权声明:本作品采用知识共享署名-非商业性使用-禁止演绎 4.0 国际许可协议进行许可,非商业转载请注明出处(作者,原文链接),商业转载请联系作者获得授权。

- 免责声明:本页面内容均来源于站内编辑发布,部分信息来源互联网,并不意味着本站赞同其观点或者证实其内容的真实性,如涉及版权等问题,请立即联系客服进行更改或删除,保证您的合法权益。转载请注明来源,欢迎对文章中的引用来源进行考证,欢迎指出任何有错误或不够清晰的表达。也可以邮件至 sblig@126.com