图解半监督学习只用张标注图片训练

作者:amitness

编译:ronghuaiyang

导读: 仅使用 10 张带有标签的图像,它在 CIFAR-10 上的中位精度为 78%,最大精度为 84%,来看看是怎么做到的。

深度学习在计算机视觉领域展示了非常有前途的结果。但是当将它应用于实际的医学成像等领域的时候,标签数据的缺乏是一个主要的挑战。

在实际环境中,对数据做标注是一个耗时和昂贵的过程。你有很多的图片,由于资源约束,只有一小部分人可以进行标注。在这样的情况下,我们如何利用大量未标注的图像以及部分已标注的图像来提高我们的模型的性能?答案是 semi-supervised 学习。

FixMatch 是 Google Brain 的 Sohn 等人最近开发的一种半监督方法,它改善了半监督学习(SSL)的技术水平。它是对之前的方法(例如 UDA 和 ReMixMatch)的简单组合。在本文中,我们将了解 FixMatch 的概念,并看到仅使用 10 张带有标签的图像,它在 CIFAR-10 上的中位精度为 78%,最大精度为 84%。

FixMatch 背后的直觉

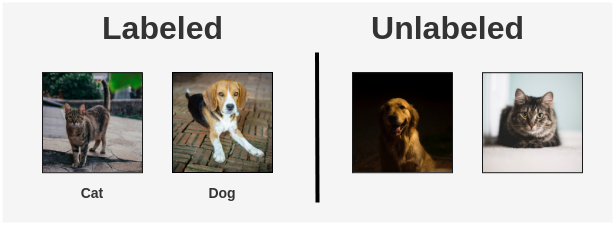

假设我们正在对猫与狗进行分类,但是我们的标签数据有限,并且有很多未标签的猫狗图像。

我们通常的“监督学习”方法将是仅在标注图像上训练分类器,而忽略未标注的图像。

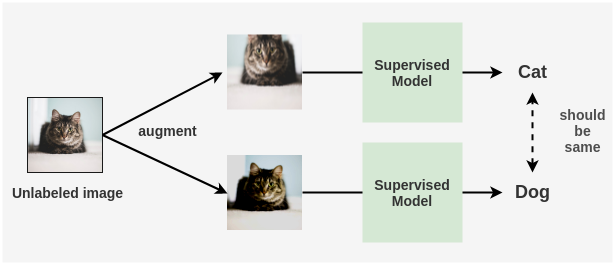

除了忽略未标注的图像,我们还可以应用以下方法。我们知道模型也应该能够处理图像的扰动,从而提高泛化能力。

如果我们对未标注的图像进行图像增强,并让监督模型预测这些图像会怎么样?由于是同一张图片,因此两者的预测的标签应该相同。

因此,即使不知道其正确的标签,我们也可以将未标注的图像用作训练流水线的一部分。这是 FixMatch 及其之前的许多论文背后的核心思想。

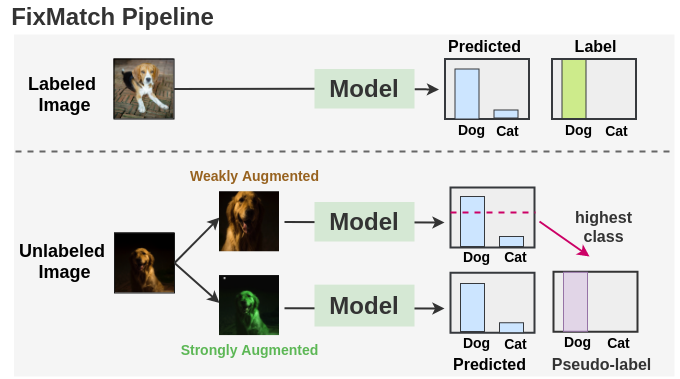

FixMatch 的 Pipeline

凭直觉,让我们看看如何在实践中实际应用 FixMatch。下图总结了整个 pipeline:

如图所示,我们使用交叉熵损失在标注的图像上训练了监督模型。对于每个未标注的图像,使用弱增强和强增强获得两个图像。弱增强图像被传递到我们的模型中,我们得到了关于类的预测。将最有信心的类别的概率与阈值进行比较。如果它高于阈值,那么我们将该类作为 ground truth 的标签,即伪标签。然后,将经过强增强的图像传递到我们的模型中,获取类别的预测。使用交叉熵损失将此概率分布与 ground truth 伪标签进行比较。两种损失组合起来进行模型的更新。

Pipeline 的组件

1. 训练数据和增强

FixMatch 借鉴了 UDA 和 ReMixMatch 的这一思想,应用不同的增强方法,即在未标注的图像上进行弱增强以生成伪标签,同时在未标注图像上进行强增强以进行预测。

a. 弱增强

对于弱增强,本文使用标准的翻转和平移策略。它包括两个简单的增强:

- Random Horizontal Flip

应用此增强的概率为 50%。对于 SVHN 数据集,将跳过此步骤,因为那些图像包含与水平翻转无关的数字。在 PyTorch 中,可以使用 transforms 执行以下操作:

from PIL import Image

import torchvision.transforms as transforms

im = Image.open('dog.png')

weak_im = transforms.RandomHorizontalFlip(p=0.5)(im)

随机水平和垂直移动

12.5%,在 PyTorch 中,可以使用以下代码来实现,其中 32 是图像的大小:

import torchvision.transforms as transforms

from PIL import Image

im = Image.open('dog.png')

resized_im = transforms.Resize(32)(im)

translated = transforms.RandomCrop(size=32,

padding=int(32*0.125),

padding_mode='reflect')(resized_im)

b. 强增强

其中包括输出严重失真的输入图像的增强版本。FixMatch 应用 RandAugment 或 CTAugment,然后应用 CutOut 增强。

1. Cutout

这种增强会随机删除图像的正方形部分,并用灰色或黑色填充。PyTorch 没有内置的 Cutout 函数,但是我们可以重用其 RandomErasing 函数来达到 CutOut 的效果。

import torch

import torchvision.transforms as transforms

# Image of 520*520

im = torch.rand(3, 520, 520)

# Fill cutout with gray color

gray_code = 127

# ratio=(1, 1) to set aspect ratio of square

# p=1 means probability is 1, so always apply cutout

# scale=(0.01, 0.01) means we want to get cutout of 1% of image area

# Hence: Cuts out gray square of 52*52

cutout_im = transforms.RandomErasing(p=1,

ratio=(1, 1),

scale=(0.01, 0.01),

value=gray_code)(im)

2. AutoAugment 的变体

以前的 SSL 使用的是 AutoAugment,这个工具训练了一个强化学习算法来寻找让代理任务(例如 CIFAR-10)得到最佳准确性的增强方法。这是有问题的,因为我们需要一些标注的数据集来学习增强,并且还受到使用 RL 的资源限制。

因此,FixMatch 使用了 AutoAugment 的两个变体之一:

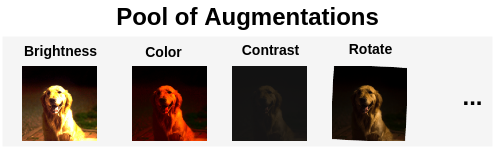

a. RandAugment

Random Augmentation(RandAugment) 思想是非常简单的。

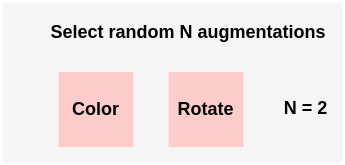

- 首先,你有一个 14 种可能的增强的列表,以及一系列可能的幅度。

- 你从这个列表里随机选出 N 个增强,这里我们从列表里选出两种。

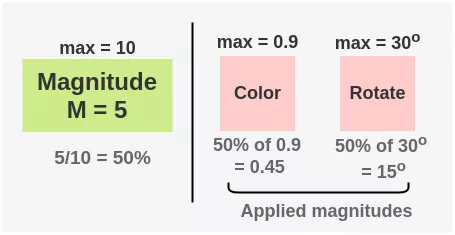

- 然后我们选择一个随机的幅度 M,从 1 到 10。我们可以选择一个幅度 5,这意味着以百分比表示的幅度为 50%,因为最大可能的 M 为 10,所以百分比 = 5/10 = 50%。

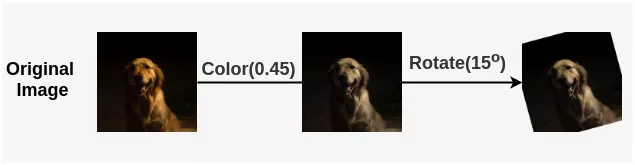

- 现在,将所选的增强应用于序列中的图像。每种增强都有 50%的可能性被应用。

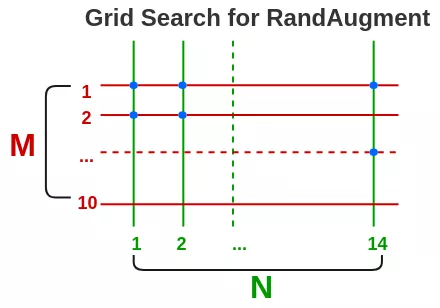

- N 和 M 的值可以通过在验证集上使用网格搜索的超参数优化来找到。在本文中,在每个训练步骤使用预定义范围内的随机幅度,而不是固定幅度。

b. CTAugment

CTAugment 是 ReMixMatch 论文中引入的一种增强技术,它使用控制理论中的思想来消除对 AutoAugment 中增强学习的需求。运作方式如下:

- 我们有一组 18 种可能的变换,类似于 RandAugment

- 变换的幅度值被划分为 bin,每个 bin 被分配一个权重。最初,所有 bin 的权重均为 1。

- 现在从该集合中以相等的概率随机选择两个变换,它们的序列形成了一条管道。这类似于 RandAugment。

- 对于每个变换,根据归一化的 bin 权重随机选择一个幅值 bin

- 现在,带有标记的样本通过这两个转换得到了增强,并传递给模型以进行预测

- 根据模型预测值与实际标签的接近程度,更新这些变换的 bin 权重。

- 因此,它学会选择具有较高的机会来预测正确的标签的模型,从而在网络容差范围内进行增强。

因此,我们看到,与 RandAugment 不同,CTAugment 可以在训练过程中动态学习每个变换的幅度。因此,我们无需在某些受监督的代理任务上对其进行优化,并且它没有敏感的超参数可优化。因此,这非常适合缺少标签数据的半监督环境。

2. 模型结构

本文使用称为 Wide Residual Networks 的 ResNet 的更广和更浅的变体作为基础体系结构。使用的确切变体是 Wide-Resnet-28-2,深度为 28,扩展因子为 2。因此,此模型的宽度是 ResNet 的两倍。它总共有 150 万个参数。该模型与输出层堆叠在一起,输出层的节点等于所需的类数(例如,用于猫/狗分类的 2 个类)。

3. 模型训练和损失函数

- 步骤 1: 准备 batches

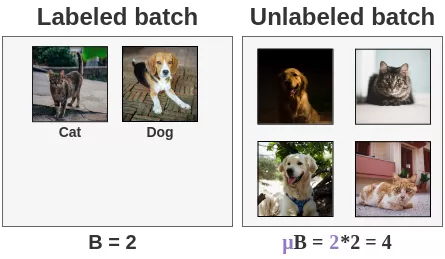

我们准备了批大小为 B 的标记图像和批大小为μB 的未标记图像。μ是一个超参数,它决定批中未标注图像的相对大小。例如,μ=2 意味着我们使用的未标注图像数量是标注图像的两倍。

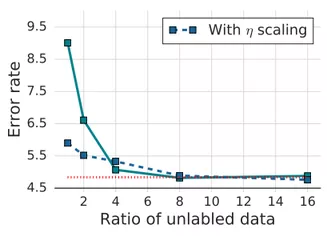

该论文尝试增加μ的值,发现随着我们增加未标注图像的数量,错误率会降低。本文将μ=7 用于验证数据集。

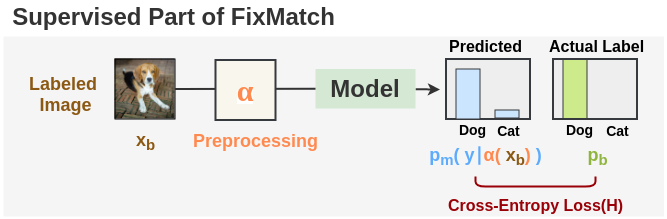

- 步骤 2: 监督学习

对于在标注图像上训练的监督部分,我们将常规的交叉熵损失 H()用于分类任务。batch 的总损失由 l_s 定义,并通过取 batch 中每个图像的交叉熵损失的平均值来计算。

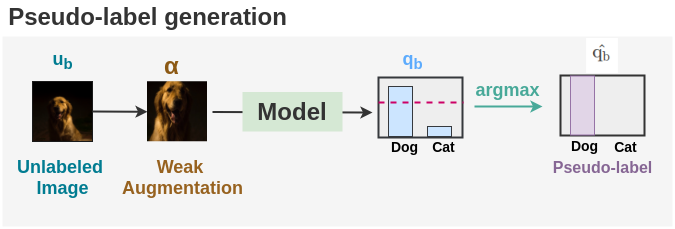

- 步骤 3: 伪标签

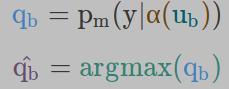

对于未标注的图像,首先我们对未标注的图像应用弱增强,并通过 argmax 获得最高概率的预测类别。这就是伪标签,将与强增强图像上的模型输出进行比较。

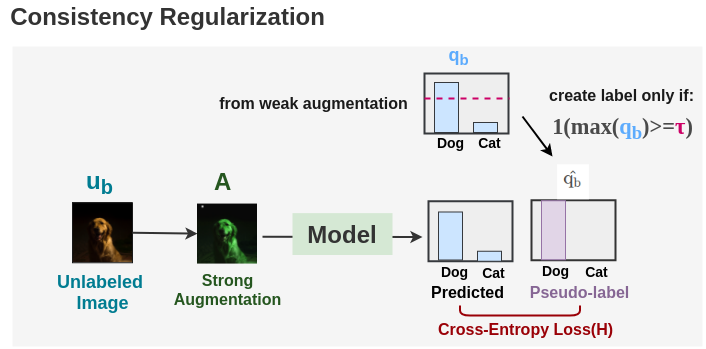

- 步骤 4: 一致性正则化

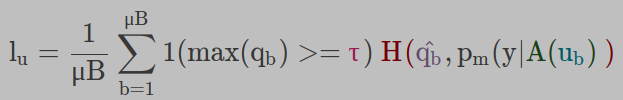

现在,同一张未标注的图片进行了强增强,并将其输出与我们的伪标签进行比较以计算交叉熵损失 H()。未标注的总 batch 损失由 l_u 表示,并由下式给出:

这里τ表示阈值,在该阈值之上我们采用伪标签。该损失类似于伪标签损失。不同之处在于,我们使用弱增强来生成标签,而强增强则用于损失。

-

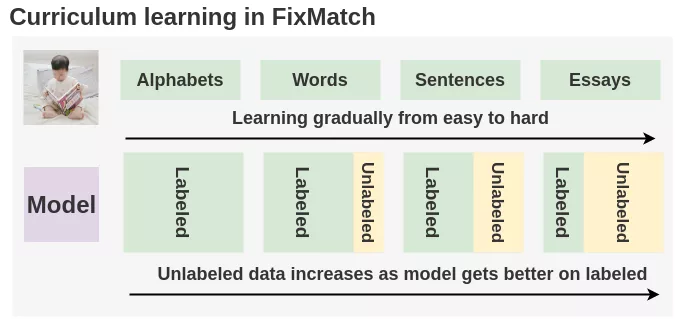

步骤 5: 课程学习

最后,我们将这两个损失相结合,以获得总损失,我们可以对其进行优化以改进模型。

\lambda_u 是一个固定的标量超参数,它决定了未标注图像损失相对于标注损失的贡献量。

loss=l_s + \lambda_u l_u

有趣的结果来自 l_u。以前的工作表明,在训练过程中增加权重是很好的。但是,在 FixMatch 中,这是自动内置的。由于最初,该模型对标注的数据没有把握,因此其对未标注的数据的输出预测将低于阈值。这样,将仅在标注的数据上训练模型。但是随着训练的进行,模型对标注的数据变得更加自信,因此,对未标注数据的预测也将开始超过阈值。这样,损失将很快也开始包含对未标注图像的预测。这为我们提供了一种免费的课程学习形式。

从直觉上讲,这类似于我们在儿童时期的教学方式。在早期,我们先学习一些简单的概念,例如字母表及其代表的含义,然后再继续学习复杂的主题,例如构词,句子和文章。

论文中的直觉

1. 我们可以每个类别只学习一张图片吗?

作者对 CIFAR-10 数据集进行了一个非常有趣的实验。他们仅使用 10 个标注图像(即每个类别 1 个标注样本)在 CIFAR-10 上训练了模型。

- 他们通过从数据集中从每个类中随机选择一个样本来创建 4 个数据集,并对每个数据集进行 4 次训练。他们达到了 48.58%至 85.32%的测试准确度,中位准确率为 64.28%。准确性的这种差异是由于标注样本的质量所致。当�

- 原文作者:知识铺

- 原文链接:https://index.zshipu.com/geek/post/%E4%BA%92%E8%81%94%E7%BD%91/%E5%9B%BE%E8%A7%A3%E5%8D%8A%E7%9B%91%E7%9D%A3%E5%AD%A6%E4%B9%A0%E5%8F%AA%E7%94%A8%E5%BC%A0%E6%A0%87%E6%B3%A8%E5%9B%BE%E7%89%87%E8%AE%AD%E7%BB%83/

- 版权声明:本作品采用知识共享署名-非商业性使用-禁止演绎 4.0 国际许可协议进行许可,非商业转载请注明出处(作者,原文链接),商业转载请联系作者获得授权。

- 免责声明:本页面内容均来源于站内编辑发布,部分信息来源互联网,并不意味着本站赞同其观点或者证实其内容的真实性,如涉及版权等问题,请立即联系客服进行更改或删除,保证您的合法权益。转载请注明来源,欢迎对文章中的引用来源进行考证,欢迎指出任何有错误或不够清晰的表达。也可以邮件至 sblig@126.com