百度发布全球领先文档解析模型 PaddleOCR-VL,重塑OCR技术格局! --知识铺

近日,百度正式发布并开源其自研的多模态文档解析模型 PaddleOCR-VL。这一模型在全球权威的文档解析评测榜单 OmniBenchDoc V1.5中,以92.6分的佳绩荣登综合性能全球第一的宝座,展现出其在文本、表格、公式和阅读顺序四大核心能力上的卓越表现。

PaddleOCR-VL 的核心模型参数仅为0.9B,具有轻量高效的特点,能够在极低的计算开销下,精准识别包括文本、手写汉字、表格、公式及图表等复杂元素。该模型支持109种语言,涵盖中文、英语、法语、日语、俄语、阿拉伯语和西班牙语等多种语言场景,适用于政企文档管理、知识检索、档案数字化以及科研信息抽取等多种智能文档处理任务。

作为文心4.5的衍生模型,PaddleOCR-VL-0.9B 通过融合 NaViT 动态分辨率视觉编码器与 ERNIE-4.5-0.3B 语言模型,成功实现了在精度和效率上的双重突破。具体而言,该模型在 OmniDocBench v1.5上的表现极为亮眼,文本编辑距离为0.035,公式识别的 CDM 为91.43,表格的 TEDS 达到了93.52,阅读顺序预测误差值为0.043,这些数据展示了其在复杂文档、手写稿及历史档案识别等高难度场景中的稳定性和可靠性。

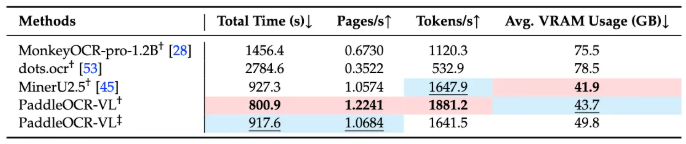

在推理速度方面,PaddleOCR-VL 在一张 A100GPU 上每秒可处理1881个 Token,相较于其他主流模型,推理速度有显著提升,较 MinerU2.5快14.2%,比 dots.ocr 更是提升了253.01%。这一表现使得 PaddleOCR-VL 在 OCR 技术中树立了新的标杆。

与传统 OCR 技术不同,PaddleOCR-VL 能够如同人类一样理解复杂的版面结构,精确提取财报表格、数学公式和课堂笔记等多元信息,并自动恢复符合人类阅读习惯的顺序,确保信息传达的准确性和逻辑的清晰性。其创新的两阶段架构,第一阶段负责版面检测与阅读顺序预测,第二阶段则进行文本、表格、公式等元素的识别与结构化输出,这种设计显著提高了识别的稳定性和效率。

- 原文作者:知识铺

- 原文链接:https://index.zshipu.com/ai002/post/20251020/%E7%99%BE%E5%BA%A6%E5%8F%91%E5%B8%83%E5%85%A8%E7%90%83%E9%A2%86%E5%85%88%E6%96%87%E6%A1%A3%E8%A7%A3%E6%9E%90%E6%A8%A1%E5%9E%8B-PaddleOCR-VL%E9%87%8D%E5%A1%91OCR%E6%8A%80%E6%9C%AF%E6%A0%BC%E5%B1%80/

- 版权声明:本作品采用知识共享署名-非商业性使用-禁止演绎 4.0 国际许可协议进行许可,非商业转载请注明出处(作者,原文链接),商业转载请联系作者获得授权。

- 免责声明:本页面内容均来源于站内编辑发布,部分信息来源互联网,并不意味着本站赞同其观点或者证实其内容的真实性,如涉及版权等问题,请立即联系客服进行更改或删除,保证您的合法权益。转载请注明来源,欢迎对文章中的引用来源进行考证,欢迎指出任何有错误或不够清晰的表达。也可以邮件至 sblig@126.com